IA locale : et si la vraie révolution n’était pas la puissance, mais la frugalité ?

À l’heure où vos fils LinkedIn s’enchaînent sur la thématique « Google a tué le game avec Gemini 3 Pro », où nos influenceurs IA promettent chaque semaine « le modèle qui enterre le précédent », j’aimerais vous proposer un contre-courant, l’IA que je défends, l’IA qui ne craint pas l’explosion d’une bulle, celle d’une idée plus simple, plus utile, presque à rebours du climat actuel : l’IA suffisante et frugale.

Une IA qui n’essaie pas d’être « la plus puissante du monde », mais qui fait juste ce dont vous avez besoin ou presque. Une IA qui tourne en local, qui respecte vos données, qui coûte ce qu’elle coûte et pas un centime de plus et si c’est sur votre ordinateur qu’elle tourne : elle est même gratuite (et peut-être lente suivant votre configuration).

Et dans cet univers, j’aimerai notamment vous parler d’un logiciel que j’utilise (et il en existe d’autres cités plus bas) : Ollama. Mais avant de parler d’Ollama, il faut poser quelques bases : qu’est-ce que l’IA locale ? Quels outils existent ? Et surtout, qu’est-ce qu’un modèle open-weight, concept que votre fil LinkedIn évoque rarement (surement pas assez putaclick) ?

Petite précision avant de commencer : cela ne m’a pas empêcher d’utiliser un mix NotebookLM et Gemini Nano Banana Pro pour préparer et travailler cette newsletter et l’illustrer.

Les bases de l’IA locale

Et la notion clé : les modèles open-weight

Pour la plupart des gens, l’IA apparaît en 2023-2024. Mais les modèles IA existent depuis des dizaines d’années. Un modèle d’IA, qu’il soit génératif ou non, est simplement un programme entraîné à reconnaître des motifs dans des données. Les modèles non génératifs prennent une entrée et produisent une prédiction : classifier une image, détecter une fraude, recommander un produit. Les modèles génératifs, eux, apprennent à créer quelque chose de nouveau à partir de ce qu’ils ont appris : du texte, des images, du code.

Il est également important que les modèles d’IA générative (comme GPT) ne sont q’un type de modèle et que le vrai potentiel de l’IA déployée en entreprise réside autant dans l’usage des IA générative que des autres.

Mais du coup c’est quoi un modèle open-weight ?

Déjà il ne faut pas confondre open-source et open-weight. Ce n’est pas la même chose.

-

Open-source : on a accès au code qui aurait créé le modèle.

-

Open-weight : on a accès aux poids du modèle, c’est-à-dire aux paramètres qui constituent son « cerveau ».

Concrètement, un modèle open-weight peut être téléchargé, exécuté en local, modifié, intégré dans une application interne et utilisé sans envoyer la moindre donnée à un fournisseur cloud.

Sans modèles open-weight, pas d’IA locale. Juste des API cloud : celles d’OpenAI, de Google, d’Anthropic, etc…

Llama 3, ceux de Mistral (https://mistral.ai/fr/models), Phi-3, Gemma, Qwen, Yi… Tous sont open-weight. Vous avez même GPT‑OSS20 et GPT‑OSS120 chez OpenAI.

Et ceux sont principalement deux acteurs français qui ont montré la voie au grand public : Mistral que chacun connait et HuggingFace, plateforme française qui héberge plusieurs centaines de milliers de modèles, jeux de données et pipelines, et qui sert aujourd’hui de place publique mondiale pour l’IA open-weight. Sans HuggingFace, l’écosystème ne serait pas aussi riche : c’est là que les communautés publient, partagent, améliorent et documentent les modèles que nous faisons tourner en local.

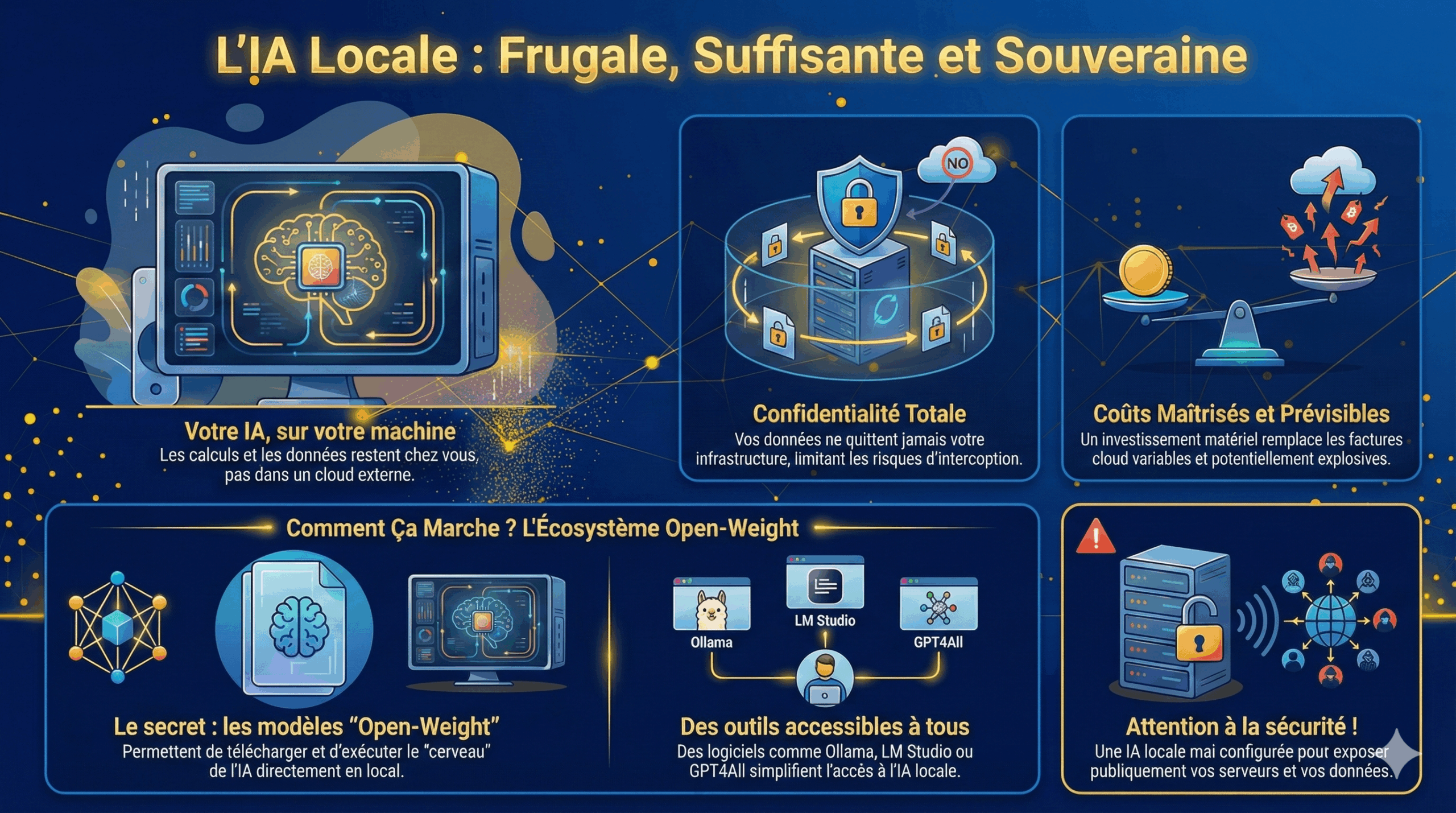

Quand je parle d’IA « locale », j’entends une IA qui tourne directement sur votre machine (ordinateur portable, PC fixe) ou sur un serveur que vous contrôlez. Pas dans le cloud, pas chez un prestataire externe, pas dans une infrastructure que vous ne maîtrisez pas. Locale signifie que les calculs, les données, les modèles et les interactions restent chez vous, physiquement ou à l’intérieur de votre réseau. C’est cette proximité technique qui garantit la confidentialité, la souveraineté et la prévisibilité des coûts.

Pourquoi utiliser une IA en locale ?

Un choix stratégique

Trois raisons principales poussent aujourd’hui entreprises et indépendants vers l’IA locale. Et ces raisons ne tiennent pas seulement à une mode technologique, mais à une évolution profonde des attentes : mieux protéger ses données, réduire sa dépendance aux géants du cloud, et gagner en autonomie opérationnelle.

Confidentialité

Les données restent chez vous. Elles ne transitent plus vers un cloud externe, ce qui limite considérablement les risques d’interception ou d’utilisation involontaire. Dans des secteurs comme la santé, la finance, le droit ou les métiers qui manipulent des informations sensibles, cette maîtrise totale devient incontournable. L’IA locale permet aussi d’éviter les problématiques liées aux transferts hors UE, souvent complexes dans un cadre RGPD. Même en interne, le simple fait de ne plus exposer vos contenus à des API externes réduit drastiquement la surface d’attaque. Bref, la confidentialité n’est plus une promesse marketing : elle devient un fait structurel.

Coûts

Avec le cloud, vous payez à l’usage. Une journée d’expérimentation peut coûter cher. Un agent mal paramétré peut multiplier vos factures sans que vous puissiez l’anticiper. Avec l’IA locale, le coût devient fixe et prévisible : vous investissez dans votre matériel, et vous en exploitez la pleine capacité. Cette logique transforme une dépense variable (OPEX) en investissement maîtrisé (CAPEX). Les entreprises qui mènent beaucoup de tests, de prototypages ou de développements IA y trouvent souvent un modèle économique plus stable.

Comment ça fonctionne ?

Reprenons l’exemple d’Ollama. Ollama n’est pas une IA. C’est une couche logicielle qui permet d’exécuter des modèles open-weight de manière fluide, en prenant en charge toute la mécanique nécessaire pour gérer les modèles, les charger en mémoire, orchestrer les requêtes et offrir une interface claire aux applications qui l’utilisent. Autrement dit, il joue le rôle d’un moteur qui fait tourner vos modèles et s’occupe de toute la tuyauterie technique pour que vous puissiez vous concentrer sur l’usage.

Il repose sur trois composants, qui forment une architecture étonnamment robuste malgré la simplicité apparente de l’outil :

-

Serveur local : c’est le cœur du système. Il expose une API REST accessible en local ou via un réseau interne, ce qui permet à n’importe quelle application, script, agent ou interface maison de communiquer avec le modèle. Le serveur gère également le chargement du modèle en mémoire et la distribution des réponses, ce qui en fait un véritable point d’entrée pour tout un écosystème interne.

-

CLI : la ligne de commande sert à piloter Ollama au quotidien. Elle permet de télécharger, exécuter, interrompre ou supprimer des modèles en quelques instructions. C’est aussi un outil précieux pour l’automatisation : intégration dans des scripts, des pipelines de tests, ou même dans des outils no-code capables d’exécuter des commandes locales.

-

Registre : Ollama donne accès à plus de 100 modèles open-weight prêts à l’emploi, qu’il télécharge automatiquement lorsqu’ils ne sont pas encore présents sur la machine. Ce registre fonctionne un peu comme une bibliothèque de conteneurs : vous choisissez un modèle, Ollama gère le reste.

Deux modes d’inférence (= faire tourner le programme du modèle) sont proposés, et comprendre leur différence est essentiel pour concevoir des usages pertinents :

-

Complétion (stateless) : idéal pour les tâches ponctuelles, les automatisations, les scripts internes ou tout ce qui ne nécessite pas d’historique. Chaque requête est traitée comme un événement indépendant.

-

Chat (stateful) : ici, Ollama conserve le contexte entre les échanges, ce qui permet d’entretenir de vraies conversations, de gérer des assistants internes ou d’enchaîner des questions liées à un même sujet. C’est ce mode qui est utilisé pour construire des agents plus avancés, capables de suivre un raisonnement ou une discussion dans la durée.

Les principaux outils, grand public, autres que Ollama qui vous permettent d’avoir une IA en locale et qui fonctionnent avec ou sans connexion internet.

Expliqués simplement, sans jargon

Plusieurs solutions permettent d’exécuter ces modèles open-weight sur une machine personnelle ou un serveur. Voici les plus courantes.

LM Studio

L’IA locale la plus simple à utiliser.

-

Interface claire

-

Aucun prérequis technique

-

Installation automatique des modèles

Idéal pour un usage individuel ou un premier contact avec l’IA locale.

GPT4All

La solution pédagogique.

-

Interface légère

-

Pensé pour l’apprentissage et l’exploration

Utile pour comprendre comment fonctionne l’IA locale.

LocalAI

Une API « à la OpenAI », mais en local.

Pour un développeur, cela signifie : changer l’URL de son API, et tout continue de fonctionner… mais localement.

PrivateGPT

La recherche documentaire en local.

Idéal pour interroger ses PDF, Word, exports internes sans cloud.

Les points d’attention

Attention à la sécurisé si vous le déployer sur vos serveurs

Une enquête Cisco Talos a identifié 1 139 serveurs Ollama exposés publiquement, visibles via Shodan.

Les risques :

-

Accès non autorisé

-

Extraction de données

-

Détournement de ressources

-

Modèles piégés

-

Attaques DNS rebinding

-

Gzip bombs

L’IA locale n’est pas sécurisée par magie. Elle l’est si vous la déployez correctement.

L’IA n’est pas magique

L’IA n’est jamais qu’un outil statistique très puissant, pas une entité capable de deviner ce que vous ne lui fournissez pas. Même les meilleurs modèles ne produisent rien de cohérent s’ils ne disposent pas de données solides et d’un contexte clair. Une IA locale, même exécutée avec un modèle impressionnant comme Llama 3 ou Mistral, reste aveugle si vous ne lui donnez pas le bon matériau. Connecter une IA à vos documents ne suffit pas : si les fichiers sont désorganisés, mal structurés, trop longs, trop vagues, ou contradictoires, le modèle restera inefficace. L’IA ne « sait » rien par elle-même. Elle ne fait qu’exploiter ce qu’on lui donne. Sans contexte, elle invente. Sans cadre, elle divague. Et sans données propres, elle se trompe. La meilleure IA du monde, couplée à vos documents sans méthodologie, ne fera que produire des réponses approximatives. Pour qu’une IA devienne vraiment utile, il faut donc la nourrir, structurer vos informations, et lui expliquer précisément ce que vous attendez d’elle.

Construire un pipeline RAG 100 % local

Là où l’IA locale devient puissante, c’est dans les systèmes RAG internes, ces architectures qui permettent de transformer un simple modèle en véritable moteur de connaissance interne. Contrairement à une IA traditionnelle qui répond uniquement sur la base de ce qu’elle a appris lors de son entraînement, un pipeline RAG (Retrieval Augmented Generation) s’appuie sur vos données réelles, vos documents, vos procédures, vos bases de connaissances. C’est ce qui en fait un outil stratégique pour les entreprises qui veulent mettre en valeur leur patrimoine informationnel sans l’exposer au cloud.

-

Ingestion de documents internes : on commence par collecter les sources les plus importantes pour l’entreprise, qu’il s’agisse de PDF, de fichiers Word, de comptes rendus, de notes internes ou même de données structurées. Ces documents sont normalisés, nettoyés et préparés pour la suite du traitement.

-

Vectorisation locale : chaque morceau de texte est transformé en un vecteur numérique qui capture son sens. Cette étape s’effectue grâce à un modèle d’embedding exécuté localement, ce qui garantit que les contenus sensibles ne quittent jamais votre environnement. La vectorisation est un moment clé, car elle conditionne la précision des futures recherches.

-

Index vectoriel (Chroma, FAISS) : les vecteurs sont stockés dans une base optimisée pour la recherche de similarité. Chroma et FAISS permettent d’interroger des milliers, voire des millions de fragments de texte avec une vitesse impressionnante. L’ensemble reste entièrement local, ce qui assure une réactivité maximale.

-

Recherche sémantique : lorsqu’une question est posée, elle est vectorisée à son tour. Le système interroge l’index et identifie les passages les plus pertinents, même si les mots ne correspondent pas exactement. Cette recherche n’est plus une simple correspondance de mots-clés, mais un véritable rapprochement de sens.

-

Génération via Llama 3 ou Mistral : les passages trouvés sont ensuite fournis au modèle local, qui génère une réponse contextualisée et précise. Le modèle ne “devine” plus : il s’appuie sur vos documents pour produire des réponses fiables et alignées sur votre réalité professionnelle.

Aucun document ne sort de votre infrastructure, aucune requête n’est envoyée vers un serveur externe et aucune donnée sensible n’est exposée. Vous construisez ainsi un assistant capable de comprendre et d’exploiter votre connaissance interne, tout en conservant une maîtrise totale de votre environnement de données.

Bon OK ça c’est moins accessible au grand public mais c’est pour ça que des gens comme moi existent et le font pour vous 🙂

Conclusion

L’IA locale est une décision stratégique

La vraie puissance ne se trouve pas toujours dans les modèles XXL. Elle se trouve dans une IA suffisante, frugale, confidentielle, souveraine et maîtrisable.

Ollama (et ses cousins LM Studio, GPT4All, LocalAI, PrivateGPT) ouvre la porte à cette approche plus calme, responsable et utile. Et en plus c’est gratuit!

La question n’est pas selon moi : « Quel est le modèle le plus puissant ? »

Mais : « De quelle IA ai-je vraiment besoin ? »

Partager cet article

Pierre Lefebvre

Fondateur de hIAppy, expert en intelligence artificielle et transformation digitale des entreprises.